Штучний інтелект має стати інструментом, який допоможе спеціалістам з кібербезпеки виявляти зловмисників. Проте дослідження Wakefield Research, підготовлене на замовлення компанії Devo, говорить про те, що багато над чим треба працювати.

Штучний інтелект є предметом захоплення протягом десятиліть. Андроїди, вигадані письменником-фантастом Філіпом К. Діком, залишаються наразі науковою фантастикою, натомість штучний інтелект є цілком реальним і відіграє все більшу роль у багатьох аспектах нашого життя.

Звісно, цікаво спостерігати за дискусією щодо за і проти людиноподібних роботів із ШІ, проте тема використання ШІ в кібербезпеці не менш цікава і починає набирати все більше обертів.

Суть полягає в тому, щоб штучний інтелект підсилював команди професіоналів з безпеки. Як показує дослідження, аналітики SOC (Security Operations Center, Центр Інформаційної Безпеки) часто перевантажені нескінченною кількістю попереджень, які щодня з’являються на їхніх екранах. Втома від тривоги стала причиною вигорання аналітиків для всієї галузі.

В ідеалі штучний інтелект міг би допомогти аналітикам SOC йти в ногу та випереджати розумних і спритних хакерів, які ефективно використовують ШІ для злочинних чи шпигунських дій. Але, на жаль, поки що цього не відбувається.

ВЕЛИКА ІЛЛЮЗІЯ ШІ

В рамках дослідження було проведено опитування 200 фахівців з ІТ-безпеки, щоб визначити, як вони ставляться до ШІ. Опитування покриває тему впровадження штучного інтелекту, що охоплює низку елементів захисту, включаючи виявлення загроз, прогнозування ризику зламу та реагування/управління інцидентами.

Міф №1: кібербезпека на основі ШІ вже існує

Усі респонденти сказали, що їхня організація використовує ШІ в одній або кількох сферах. Найпопулярнішою сферою використання є управління інвентаризацією ІТ-активів, потім виявлення загроз (що є гарною новиною) і прогнозування ризиків зламу.

Але з точки зору використання штучного інтелекту безпосередньо в боротьбі із зловмисниками, на даний момент про це не йдеться. Приблизно 67% респондентів сказали, що їхня організація використовує штучний інтелект «дуже й дуже поверхнево».

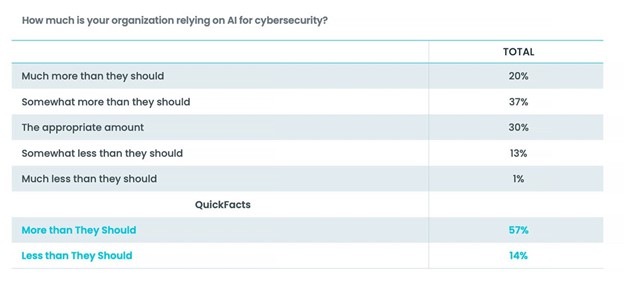

В якій мірі організації розраховують на штучний інтелект у кібербезпеці

Більше половини респондентів вважають, що їхня організація — принаймні зараз — надто покладається на ШІ. Менше однієї третини вважають, що є доцільним покладатися на штучний інтелект, тоді як меншість респондентів вважає, що їхня організація недостатньо використовує штучний інтелект.

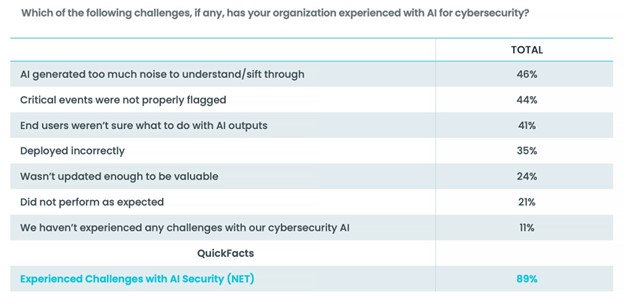

Міф №2: ШІ вирішить проблеми безпеки

Коли респондентів запитали їхню думку щодо проблем, пов’язаних із використанням штучного інтелекту в їхніх організаціях, вони не соромилися. Лише 11% респондентів сказали, що не стикалися з проблемами використання ШІ у кібербезпеці. Переважна більшість респондентів бачать ситуацію зовсім інакше.

Коли їх запитали, в якій частині програми захисту їхньої організації виникли проблеми, пов’язані зі штучним інтелектом, відповіді стосувались ключових функцій кібербезпеки. Крім того, що управління інвентаризацією ІТ-активів назвали головною проблемною областю штучного інтелекту, інші три категорії кібербезпеки також потрапили до цього переліку згідно 53% респондентів:

- Виявлення загроз (33%)

- Розуміння сильних сторін і недоліків кібербезпеки (24%)

- Оцінка ризиків порушення безпеки (23%)

Цікаво відзначити, що набагато менше респондентів (13%) зазначили, що у ШІ є проблема з реагуванням на інциденти.

Міф №3: штучний інтелект розумний, тому він має бути ефективним

Очевидно, що хоча ШІ вже використовується в кібербезпеці, результати неоднозначні. Велика брехня полягає в тому, що не весь штучний інтелект є таким «розумним», як випливає з назви, і це навіть без урахування відповідності потребам і можливостям організації.

Індустрія кібербезпеки вже давно у пошуці «чарівної палички». Штучний Інтелект є одним з трендів. Розгортаючи та оцінюючи ШІ рішення, організації повинні робити це зважено та орієнтуватися на результати ШІ. Якщо команди SOC не об’єднають штучний інтелект з досвідченими експертами, які знають технологію, вони ризикують зазнати невдачі у критичній галузі, яка практично не дає права на помилку.

Джерело: Devo